Maksymalizacja zwrotu z inwestycji dzięki generatywnej sztucznej inteligencji:

Strategiczny przewodnik dla liderów biznesu

Generatywna sztuczna inteligencja przekształciła się z ciekawostki w podstawowy silnik nowoczesnych operacji biznesowych. Do 2026 roku nie chodzi już tylko o chatboty; chodzi o autonomiczne agenty, zautomatyzowane przepływy pracy i szybkie syntezowanie danych. Ale jak ta technologia faktycznie działa „pod maską” i jak Twoja organizacja może bezpiecznie z niej korzystać?

Czym jest Generatywna Sztuczna Inteligencja w 2026 roku?

Generatywna sztuczna inteligencja to podzbiór sztucznej inteligencji zaprojektowany do tworzenia oryginalnych treści — od tekstów i kodu po obrazy wysokiej jakości oraz dane syntetyczne. W przeciwieństwie do tradycyjnej „Dyskryminacyjnej SI”, która jedynie klasyfikuje istniejące dane, generatywna SI wykorzystuje zaawansowane sieci neuronowe do rozpoznawania ukrytych wzorców i syntezowania całkowicie nowych wyników, które naśladują ludzką kreatywność i logikę.

Dla firm oznacza to ogromne korzyści w zakresie skalowalności, umożliwiając zespołom automatyzację złożonych zadań poznawczych, które wcześniej wymagały ręcznej interwencji.

Jak działa generatywna sztuczna inteligencja? (Architektura LLM)

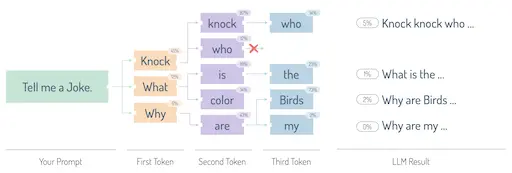

Nowoczesna generatywna sztuczna inteligencja jest przede wszystkim napędzana przez Duże Modele Językowe (LLM). Początkowo wprowadzone przez artykuł Google'a "Attention is All You Need", te modele działają jako zaawansowane silniki probabilistyczne. Gdy podajesz prompt, model oblicza prawdopodobieństwo kolejnego "tokena" (słowa lub fragmentu) na podstawie bilionów punktów danych, które przetworzył podczas treningu. Nie "zna" faktów w ludzkim sensie; przewiduje najbardziej statystycznie logiczne kontynuacje twojej myśli.

Transformery i Okna Kontekstowe: "Mózg" Sztucznej Inteligencji

Architektura Transformera umożliwia sztucznej inteligencji rozumienie kontekstu. W przeciwieństwie do starszych modeli, które czytały tekst liniowo, Transformerzy wykorzystują "Mechanizmy Uwag" do jednoczesnego analizowania całego dokumentu.

Dla CTO najważniejszą koncepcją dzisiaj jest Okno Kontekstowe. To określa, ile informacji AI może "pamiętać" podczas rozmowy. Nowoczesne modele obsługują teraz ogromne okna, pozwalając na przesyłanie całych dokumentacji technicznych lub baz kodu do analizy przez AI bez utraty początkowych instrukcji. To właśnie tutaj Inżynieria Promptów staje się umiejętnością o wysokim wpływie — strukturyzowanie swojego wejścia, aby skierować uwagę modelu.

Aby zmaksymalizować jakość swoich wyników, skorzystaj z naszego Optymalizatora promptów ChatGPT, aby udoskonalić swoje instrukcje i uzyskać rezultaty na poziomie korporacyjnym.

Proces szkoleniowy przedsiębiorstwa

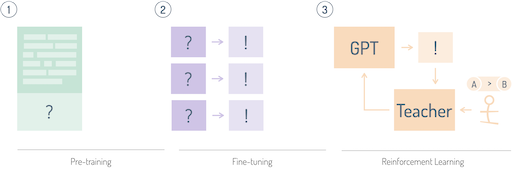

Budowa modelu gotowego do produkcji, takiego jak GPT-4o lub Claude 3.5/4, obejmuje trzy zaawansowane etapy:

- Uczenie się wstępne samonadzorowane: Model "czyta" otwarty internet oraz prywatne zbiory danych, aby nauczyć się struktury języka, logiki, a nawet podstaw programowania.

- Dostrajanie instrukcji: Model jest trenowany na starannie dobranych parach pytań i odpowiedzi. Uczy to AI, jak zachowywać się jako pomocny asystent, a nie tylko jako uzupełniacz tekstu.

- Dopasowanie preferencji (RLHF i DPO): Za pomocą technik takich jak Uczenie ze wzmocnieniem na podstawie informacji zwrotnej od ludzi (RLHF), model jest "dopieszczany" przez ludzkich testerów, którzy oceniają odpowiedzi. Zapewnia to, że AI pozostaje bezpieczne, pomocne i zgodne z wartościami firmy.

Generowanie autoregresywne i próbkowanie

Podczas generowania odpowiedzi AI korzysta z generowania autoregresywnego — przewidując kolejny token na podstawie wszystkich poprzednich tokenów w sekwencji. Aby zapobiec zbyt dużej powtarzalności lub "robotyczności" AI, stosujemy techniki próbkowania (takie jak Top-P i Temperatura).

Dostosowanie Temperatury pozwala użytkownikom biznesowym przełączać się między „Precyzją” a „Kreatywnością”. Niska temperatura (0,1) jest idealna do streszczeń prawnych lub ekstrakcji danych, podczas gdy wysoka temperatura (0,8+) lepiej sprawdza się przy burzy mózgów nad sloganami marketingowymi lub twórczym pisaniu.

Zabezpieczanie przyszłości Twojej firmy: poza chatbotem

W 2026 roku prawdziwa wartość Generatywnej Sztucznej Inteligencji leży w Generowaniu Wspomaganym Wyszukiwaniem (RAG) oraz Agentach AI. RAG pozwala SI na "wyszukiwanie" prywatnych, aktualnych danych Twojej firmy przed udzieleniem odpowiedzi, praktycznie eliminując halucynacje. Tymczasem Agenci AI mogą teraz autonomicznie wykonywać zadania — takie jak umawianie spotkań, aktualizowanie CRM czy pisanie i wdrażanie kodu.

Wdrażanie tych technologii to nie tylko kwestia efektywności; chodzi o zbudowanie skalowalnej, opartej na danych fosy wokół Twojego biznesu. Zrozumienie tych podstaw zapewnia, że możesz pewnie poprowadzić swoją organizację przez transformację AI.

Przyszłość pracy nie jest tylko wspomagana przez sztuczną inteligencję — jest przez nią przyspieszana.