Massimizzare il ROI con l'IA Generativa:

Una guida strategica per i leader aziendali

L'IA generativa è passata da una novità a diventare il motore centrale delle operazioni aziendali moderne. Entro il 2026, non si tratterà più solo di chatbot; si parlerà di agenti autonomi, flussi di lavoro automatizzati e sintesi dati ad alta velocità. Ma come funziona realmente questa tecnologia sotto il cofano, e come può la tua organizzazione sfruttarla in modo sicuro?

Cos'è l'IA generativa nel 2026?

L'IA generativa è un sottoinsieme dell'intelligenza artificiale progettato per creare contenuti originali—che spaziano da testi e codice a immagini ad alta fedeltà e dati sintetici. A differenza della tradizionale "IA discriminativa", che si limita a classificare dati esistenti, l'IA generativa utilizza reti neurali avanzate per riconoscere schemi sottostanti e sintetizzare output completamente nuovi che imitano la creatività e la logica umana.

Per le aziende, questo si traduce in enormi guadagni in termini di scalabilità, consentendo ai team di automatizzare compiti cognitivi complessi che in precedenza richiedevano un intervento manuale.

Come Funziona l'IA Generativa? (L'Architettura LLM)

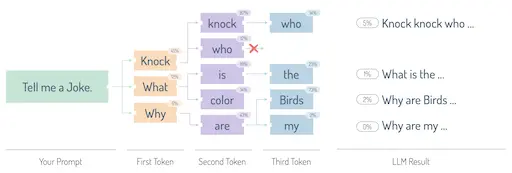

L'IA generativa moderna è principalmente alimentata da Large Language Models (LLMs). Originariamente introdotti dal paper di Google "Attention is All You Need", questi modelli funzionano come sofisticati motori probabilistici. Quando fornisci un prompt, il modello calcola la probabilità del prossimo "token" (parola o frammento) basandosi sui trilioni di dati elaborati durante l'addestramento. Non "conosce" i fatti nel senso umano; predice la continuazione statisticamente più logica del tuo pensiero.

Transformers e Finestre di Contesto: il "Cervello" dell'IA

L'architettura Transformer è ciò che permette all'IA di comprendere il contesto. A differenza dei modelli più vecchi che leggono il testo in modo lineare, i Transformer utilizzano i "Meccanismi di Attenzione" per esaminare un intero documento simultaneamente.

Per i CTO, il concetto più critico oggi è la Finestra di Contesto. Questa determina quante informazioni l'IA può "tenere a mente" durante una conversazione. I modelli moderni ora supportano finestre massive, permettendoti di caricare intere documentazioni tecniche o basi di codice affinché l'IA le analizzi senza perdere di vista le istruzioni iniziali. È qui che la Prompt Engineering diventa una competenza ad alto impatto—strutturare il tuo input per guidare il focus del modello.

Per massimizzare la qualità del tuo output, utilizza il nostro ChatGPT Prompt Optimizer per perfezionare le tue istruzioni e ottenere risultati di livello aziendale.

La Pipeline di Formazione Aziendale

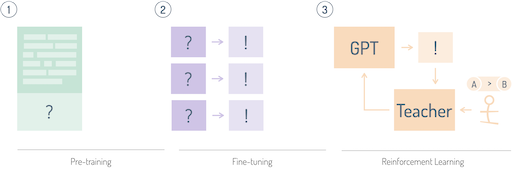

Costruire un modello pronto per la produzione come GPT-4o o Claude 3.5/4 comporta tre fasi sofisticate:

- Pre-allenamento Auto-Supervisionato: Il modello "legge" il web aperto e dataset privati per apprendere la struttura del linguaggio, la logica e persino la programmazione di base.

- Fine-Tuning Istruttivo: Il modello viene addestrato su coppie curate di domande e risposte. Questo insegna all'IA come comportarsi da assistente utile piuttosto che semplicemente completare il testo.

- Allineamento delle Preferenze (RLHF & DPO): Utilizzando tecniche come Reinforcement Learning from Human Feedback (RLHF), il modello viene "rifinito" da tester umani che classificano le risposte. Questo garantisce che l'IA rimanga sicura, utile e allineata ai valori aziendali.

Generazione e Campionamento Auto-Regressivi

Quando genera una risposta, l'IA utilizza la generazione auto-regressiva—prevedendo il token successivo basandosi su tutti i token precedenti nella sequenza. Per evitare che l'IA risulti troppo ripetitiva o "robotica", utilizziamo le tecniche di campionamento (come Top-P e Temperatura).

Regolare la Temperatura consente agli utenti aziendali di passare tra "Precisione" e "Creatività". Una temperatura bassa (0,1) è ideale per riassunti legali o estrazione di dati, mentre una temperatura alta (0,8+) è più adatta per il brainstorming di slogan pubblicitari o scrittura creativa.

Proteggere il Futuro della Tua Impresa: Oltre il Chatbot

Nel 2026, il vero valore dell'Intelligenza Artificiale Generativa risiede in Retrieval-Augmented Generation (RAG) e Agenti AI. RAG consente all'IA di "consultare" i dati privati e in tempo reale della tua azienda prima di rispondere, eliminando praticamente le allucinazioni. Nel frattempo, gli Agenti AI possono ora eseguire compiti—come prenotare riunioni, aggiornare CRM o scrivere e distribuire codice—in modo autonomo.

Implementare queste tecnologie non riguarda solo l'efficienza; si tratta di costruire un fossato scalabile e basato sui dati intorno alla tua azienda. Comprendere questi fondamenti ti assicura di poter guidare la tua organizzazione attraverso la transizione all'IA con fiducia.

Il futuro del lavoro non è solo assistito dall'IA, ma è accelerato da essa.