Maximizando el ROI con IA Generativa:

Una Guía Estratégica para Líderes Empresariales

La IA generativa ha evolucionado de ser una novedad a convertirse en el motor central de las operaciones empresariales modernas. Para 2026, ya no se trata solo de chatbots; se trata de agentes autónomos, flujos de trabajo automatizados y síntesis de datos a alta velocidad. Pero, ¿cómo funciona realmente esta tecnología en su núcleo y cómo puede su organización aprovecharla de manera segura?

¿Qué es la IA Generativa en 2026?

La IA generativa es un subconjunto de la inteligencia artificial diseñado para crear contenido original, que abarca desde texto y código hasta imágenes de alta fidelidad y datos sintéticos. A diferencia de la "IA discriminativa" tradicional, que simplemente clasifica datos existentes, la IA generativa utiliza redes neuronales avanzadas para reconocer patrones subyacentes y sintetizar salidas completamente nuevas que imitan la creatividad y lógica humanas.

Para las empresas, esto se traduce en enormes ganancias en escalabilidad, permitiendo a los equipos automatizar tareas cognitivas complejas que anteriormente requerían intervención manual.

¿Cómo funciona la IA generativa? (La arquitectura LLM)

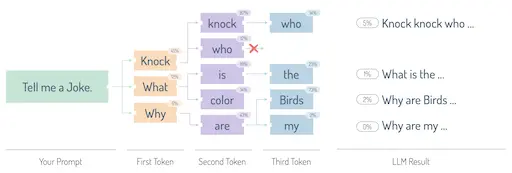

La IA generativa moderna se basa principalmente en Modelos de Lenguaje a Gran Escala (LLMs). Originalmente introducidos por el artículo de Google "Attention is All You Need", estos modelos funcionan como motores probabilísticos sofisticados. Cuando proporcionas un prompt, el modelo calcula la probabilidad del siguiente "token" (palabra o fragmento) basándose en los trillones de puntos de datos que procesó durante el entrenamiento. No "conoce" hechos en el sentido humano; predice la continuación estadísticamente más lógica de tu pensamiento.

Transformers y Ventanas de Contexto: el "Cerebro" de la IA

La arquitectura Transformer es lo que permite que la IA entienda el contexto. A diferencia de los modelos antiguos que leían el texto de forma lineal, los Transformers utilizan "Mecanismos de Atención" para analizar un documento completo simultáneamente.

Para los CTO, el concepto más crítico hoy en día es la Ventana de Contexto. Esto determina cuánta información puede "tener en cuenta" la IA durante una conversación. Los modelos modernos ahora soportan ventanas masivas, lo que permite subir documentaciones técnicas completas o bases de código para que la IA las analice sin perder de vista las instrucciones iniciales. Aquí es donde la Ingeniería de Prompts se convierte en una habilidad de alto impacto: estructurar tu entrada para guiar el enfoque del modelo.

Para maximizar la calidad de su producción, utilice nuestro Optimizador de Indicaciones de ChatGPT para perfeccionar sus instrucciones y obtener resultados de nivel empresarial.

La Cadena de Formación Empresarial

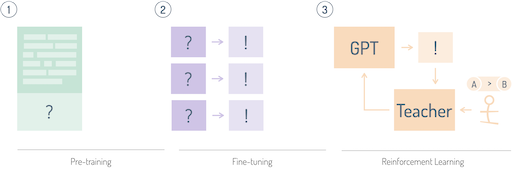

Construir un modelo listo para producción como GPT-4o o Claude 3.5/4 implica tres etapas sofisticadas:

- Preentrenamiento Auto-supervisado: El modelo "lee" la web abierta y conjuntos de datos privados para aprender la estructura del lenguaje, la lógica e incluso la programación básica.

- Ajuste Fino por Instrucción: El modelo se entrena con pares seleccionados de preguntas y respuestas. Esto enseña a la IA cómo comportarse como un asistente útil en lugar de solo completar texto.

- Alineación de Preferencias (RLHF y DPO): Usando técnicas como Aprendizaje por Refuerzo a partir de Retroalimentación Humana (RLHF), el modelo es "pulido" por evaluadores humanos que clasifican las respuestas. Esto asegura que la IA se mantenga segura, útil y alineada con los valores de la empresa.

Generación y Muestreo Auto-Regresivo

Al generar una respuesta, la IA utiliza generación autorregresiva, prediciendo el siguiente token basándose en todos los tokens anteriores de la secuencia. Para evitar que la IA sea demasiado repetitiva o "robótica", usamos técnicas de muestreo (como Top-P y Temperatura).

Ajustar la Temperatura permite a los usuarios empresariales alternar entre "Precisión" y "Creatividad." Una temperatura baja (0.1) es ideal para resúmenes legales o extracción de datos, mientras que una temperatura alta (0.8+) es mejor para generar ideas para eslóganes de marketing o escritura creativa.

Preparando su negocio para el futuro: Más allá del chatbot

En 2026, el valor real de la IA Generativa radica en Generación Aumentada por Recuperación (RAG) y Agentes de IA. RAG permite que la IA "consulte" los datos privados y en tiempo real de su empresa antes de responder, eliminando prácticamente las alucinaciones. Mientras tanto, los Agentes de IA ahora pueden ejecutar tareas de forma autónoma, como programar reuniones, actualizar CRM o escribir y desplegar código.

Implementar estas tecnologías no se trata solo de eficiencia; se trata de construir un foso escalable y basado en datos alrededor de su negocio. Comprender estos fundamentos garantiza que pueda liderar su organización a través de la transición hacia la IA con confianza.

El futuro del trabajo no solo está asistido por la IA, sino que está acelerado por ella.