Maximierung des ROI mit Generativer KI:

Ein strategischer Leitfaden für Geschäftsleiter

Generative KI hat sich von einer Neuheit zum Kernmotor moderner Geschäftsabläufe entwickelt. Bis 2026 geht es nicht mehr nur um Chatbots; es geht um autonome Agenten, automatisierte Arbeitsabläufe und Hochgeschwindigkeits-Datensynthese. Aber wie funktioniert diese Technologie eigentlich im Detail, und wie kann Ihre Organisation sie sicher nutzen?

Was ist Generative KI im Jahr 2026?

Generative KI ist ein Teilbereich der künstlichen Intelligenz, der darauf ausgelegt ist, originelle Inhalte zu erstellen – von Text und Code bis hin zu hochauflösenden Bildern und synthetischen Daten. Im Gegensatz zur traditionellen "Discriminative KI", die lediglich bestehende Daten klassifiziert, verwendet Generative KI fortschrittliche neuronale Netzwerke, um zugrunde liegende Muster zu erkennen und völlig neue Ausgaben zu erzeugen, die menschliche Kreativität und Logik nachahmen.

Für Unternehmen bedeutet dies enorme Steigerungen der Skalierbarkeit, da Teams komplexe kognitive Aufgaben automatisieren können, die zuvor manuelle Eingriffe erforderten.

Wie funktioniert generative KI? (Die LLM-Architektur)

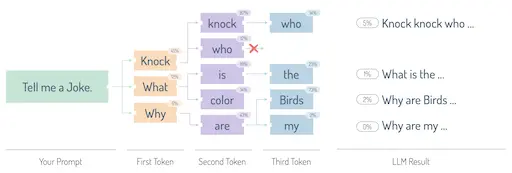

Moderne generative KI wird hauptsächlich von Large Language Models (LLMs) angetrieben. Ursprünglich eingeführt durch Googles "Attention is All You Need"-Papier, funktionieren diese Modelle als ausgeklügelte probabilistische Motoren. Wenn Sie eine Eingabe machen, berechnet das Modell die Wahrscheinlichkeit des nächsten "Tokens" (Wortes oder Fragments) basierend auf den Billionen von Datenpunkten, die es während des Trainings verarbeitet hat. Es "kennt" keine Fakten im menschlichen Sinne; es sagt die statistisch logischste Fortsetzung Ihres Gedankens voraus.

Transformers und Kontextfenster: Das "Gehirn" der KI

Die Transformer-Architektur ermöglicht es der KI, den Kontext zu verstehen. Im Gegensatz zu älteren Modellen, die Texte linear lesen, verwenden Transformer "Aufmerksamkeitsmechanismen", um ein gesamtes Dokument gleichzeitig zu betrachten.

Für CTOs ist heute das wichtigste Konzept das Context Window. Dieses bestimmt, wie viele Informationen die KI während eines Gesprächs "im Gedächtnis behalten" kann. Moderne Modelle unterstützen inzwischen sehr große Fenster, die es ermöglichen, komplette technische Dokumentationen oder Codebasen hochzuladen, damit die KI sie analysieren kann, ohne die ursprünglichen Anweisungen aus den Augen zu verlieren. Hier wird Prompt Engineering zu einer besonders wirkungsvollen Fähigkeit – die Eingabe so zu strukturieren, dass der Fokus des Modells gelenkt wird.

Um Ihre Ausgabequalität zu maximieren, verwenden Sie unseren ChatGPT Prompt Optimizer, um Ihre Anweisungen für Ergebnisse auf Unternehmensniveau zu verfeinern.

Die Enterprise Training Pipeline

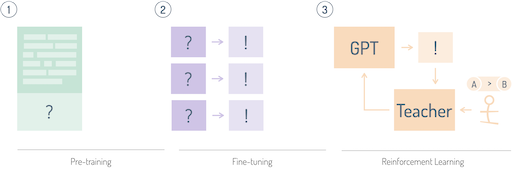

Der Aufbau eines produktionsreifen Modells wie GPT-4o oder Claude 3.5/4 umfasst drei anspruchsvolle Phasen:

- Selbstüberwachtes Vortraining: Das Modell "liest" das offene Web und private Datensätze, um die Struktur von Sprache, Logik und sogar grundlegender Programmierung zu erlernen.

- Feinabstimmung durch Instruktionen: Das Modell wird mit sorgfältig ausgewählten Frage-Antwort-Paaren trainiert. Dies lehrt die KI, sich als hilfreicher Assistent zu verhalten, anstatt nur Texte zu vervollständigen.

- Präferenzabstimmung (RLHF & DPO): Mithilfe von Techniken wie Reinforcement Learning from Human Feedback (RLHF) wird das Modell von menschlichen Testern "poliert", die Antworten bewerten. Dies stellt sicher, dass die KI sicher, hilfreich und mit den Unternehmenswerten im Einklang bleibt.

Auto-regressive Generierung & Sampling

Bei der Generierung einer Antwort verwendet die KI auto-regressive Generierung – sie sagt das nächste Token basierend auf allen vorherigen Tokens in der Sequenz voraus. Um zu verhindern, dass die KI zu repetitiv oder "robotisch" wirkt, verwenden wir Sampling-Techniken (wie Top-P und Temperatur).

Die Anpassung der Temperatur ermöglicht es Geschäftsanwendern, zwischen "Präzision" und "Kreativität" zu wechseln. Eine niedrige Temperatur (0,1) ist ideal für juristische Zusammenfassungen oder Datenauszüge, während eine hohe Temperatur (0,8+) besser für das Brainstorming von Marketing-Slogans oder kreatives Schreiben geeignet ist.

Zukunftssicherung Ihres Unternehmens: Über den Chatbot hinaus

Im Jahr 2026 liegt der wahre Wert von Generative AI in Retrieval-Augmented Generation (RAG) und KI-Agenten. RAG ermöglicht es der KI, vor der Beantwortung auf die privaten, aktuellen Daten Ihres Unternehmens zuzugreifen, wodurch Halluzinationen praktisch ausgeschlossen werden. Gleichzeitig können KI-Agenten jetzt Aufgaben autonom ausführen – wie das Buchen von Meetings, das Aktualisieren von CRM-Systemen oder das Schreiben und Bereitstellen von Code.

Die Implementierung dieser Technologien geht nicht nur um Effizienz; es geht darum, einen skalierbaren, datengetriebenen Schutzwall um Ihr Unternehmen zu errichten. Das Verständnis dieser Grundlagen stellt sicher, dass Sie Ihre Organisation mit Zuversicht durch den KI-Übergang führen können.

Die Zukunft der Arbeit wird nicht nur von KI unterstützt – sie wird durch sie beschleunigt.