Maximaliseren van ROI met Generatieve AI:

Een strategische gids voor bedrijfsleiders

Generatieve AI is geëvolueerd van een nieuwigheid tot de kernmotor van moderne bedrijfsvoering. Tegen 2026 gaat het niet langer alleen om chatbots; het draait om autonome agenten, geautomatiseerde workflows en razendsnelle datasynthese. Maar hoe werkt deze technologie eigenlijk achter de schermen, en hoe kan uw organisatie er op een veilige manier gebruik van maken?

Wat is Generatieve AI in 2026?

Generatieve AI is een subset van kunstmatige intelligentie die is ontworpen om originele inhoud te creëren—variërend van tekst en code tot hoogwaardige afbeeldingen en synthetische data. In tegenstelling tot traditionele "Discriminatieve AI," die alleen bestaande data classificeert, gebruikt Generatieve AI geavanceerde neurale netwerken om onderliggende patronen te herkennen en volledig nieuwe output te synthetiseren die menselijke creativiteit en logica nabootst.

Voor bedrijven vertaalt dit zich in enorme schaalvoordelen, waardoor teams complexe cognitieve taken kunnen automatiseren die voorheen handmatige tussenkomst vereisten.

Hoe Werkt Generatieve AI? (De LLM Architectuur)

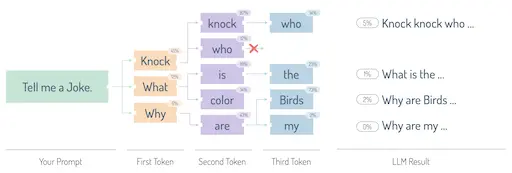

Moderne Generatieve AI wordt voornamelijk aangedreven door Large Language Models (LLM's). Oorspronkelijk geïntroduceerd door Google's "Attention is All You Need" paper, functioneren deze modellen als geavanceerde probabilistische motoren. Wanneer je een prompt geeft, berekent het model de waarschijnlijkheid van de volgende "token" (woord of fragment) op basis van de biljoenen datapunten die het tijdens de training heeft verwerkt. Het "weet" geen feiten in menselijke zin; het voorspelt de meest statistisch logische voortzetting van je gedachte.

Transformers en Contextvensters: Het "Brein" van de AI

De Transformer-architectuur is wat AI in staat stelt context te begrijpen. In tegenstelling tot oudere modellen die tekst lineair lezen, gebruiken Transformers "Attention Mechanisms" om een heel document tegelijkertijd te bekijken.

Voor CTO's is het meest cruciale concept tegenwoordig het Context Window. Dit bepaalt hoeveel informatie de AI tijdens een gesprek "in gedachten kan houden". Moderne modellen ondersteunen nu enorme vensters, waardoor je volledige technische documentaties of codebases kunt uploaden voor de AI om te analyseren zonder de oorspronkelijke instructies uit het oog te verliezen. Hier wordt Prompt Engineering een vaardigheid met grote impact—het structureren van je input om de focus van het model te sturen.

Om uw outputkwaliteit te maximaliseren, gebruikt u onze ChatGPT Prompt Optimizer om uw instructies te verfijnen voor resultaten van ondernemingsniveau.

De Enterprise Training Pipeline

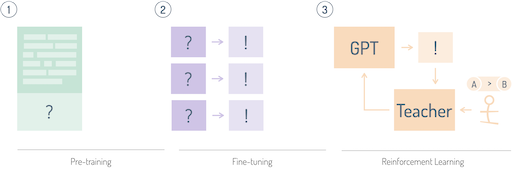

Het bouwen van een productieklaar model zoals GPT-4o of Claude 3.5/4 omvat drie geavanceerde fasen:

- Zelf-gestuurde Voortraining: Het model "leest" het open web en privédatasets om de structuur van taal, logica en zelfs basisprogrammering te leren.

- Instructie Fijnafstemming: Het model wordt getraind op samengestelde paren van vragen en antwoorden. Dit leert de AI hoe ze zich moet gedragen als een behulpzame assistent in plaats van alleen een tekstaanvuller.

- Voorkeur Afstemming (RLHF & DPO): Met technieken zoals Reinforcement Learning from Human Feedback (RLHF) wordt het model "gepolijst" door menselijke testers die reacties rangschikken. Dit zorgt ervoor dat de AI veilig, behulpzaam en in lijn met de bedrijfswaarden blijft.

Auto-Regressieve Generatie & Sampling

Bij het genereren van een antwoord gebruikt de AI Auto-regressieve generatie—het voorspellen van het volgende token op basis van alle voorgaande tokens in de reeks. Om te voorkomen dat de AI te repetitief of "robotachtig" wordt, gebruiken we Samplingtechnieken (zoals Top-P en Temperatuur).

Het aanpassen van de Temperatuur stelt zakelijke gebruikers in staat om te schakelen tussen "Precisie" en "Creativiteit." Een lage temperatuur (0,1) is ideaal voor juridische samenvattingen of data-extractie, terwijl een hoge temperatuur (0,8+) beter is voor het bedenken van marketing slogans of creatief schrijven.

Toekomstbestendig maken van uw bedrijf: verder dan de chatbot

In 2026 ligt de echte waarde van Generatieve AI in Retrieval-Augmented Generation (RAG) en AI Agents. RAG stelt de AI in staat om de privé, real-time data van uw bedrijf "op te zoeken" voordat het antwoord geeft, waardoor hallucinaties vrijwel worden geëlimineerd. Ondertussen kunnen AI Agents nu taken autonoom uitvoeren—zoals het boeken van vergaderingen, het bijwerken van CRM-systemen, of het schrijven en implementeren van code.

Het implementeren van deze technologieën gaat niet alleen over efficiëntie; het gaat erom een schaalbare, datagedreven gracht rond uw bedrijf te bouwen. Het begrijpen van deze basisprincipes zorgt ervoor dat u uw organisatie met vertrouwen door de AI-transitie kunt leiden.

De toekomst van werk wordt niet alleen ondersteund door AI, maar erdoor versneld.