Maximera avkastningen med generativ AI:

En strategisk guide för företagsledare

Generativ AI har utvecklats från en nyhet till kärnmotorn i moderna affärsverksamheter. År 2026 handlar det inte längre bara om chatbots; det handlar om autonoma agenter, automatiserade arbetsflöden och högpresterande datasyntes. Men hur fungerar egentligen denna teknik under ytan, och hur kan din organisation använda den på ett säkert sätt?

Vad är Generativ AI år 2026?

Generativ AI är en underkategori av artificiell intelligens som är utformad för att skapa originalinnehåll – från text och kod till högupplösta bilder och syntetiska data. Till skillnad från traditionell "Diskriminerande AI", som endast klassificerar befintliga data, använder Generativ AI avancerade neurala nätverk för att känna igen underliggande mönster och syntetisera helt nya resultat som efterliknar mänsklig kreativitet och logik.

För företag innebär detta enorma vinster i skalbarhet, vilket gör det möjligt för team att automatisera komplexa kognitiva uppgifter som tidigare krävde manuell inblandning.

Hur fungerar generativ AI? (LLM-arkitekturen)

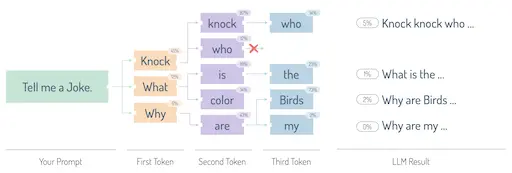

Modern generativ AI drivs främst av Large Language Models (LLMs). Ursprungligen introducerade i Googles artikel "Attention is All You Need", fungerar dessa modeller som sofistikerade probabilistiska motorer. När du ger en prompt beräknar modellen sannolikheten för nästa "token" (ord eller fragment) baserat på de biljoner datapunkter den bearbetade under träningen. Den "vet" inte fakta på samma sätt som människor; den förutspår den mest statistiskt logiska fortsättningen på din tanke.

Transformers och kontextfönster: AI:s "hjärna"

Transformer-arkitekturen är det som gör att AI kan förstå kontext. Till skillnad från äldre modeller som läser text linjärt, använder Transformers "Attention Mechanisms" för att samtidigt se hela dokumentet.

För CTO:er är det mest kritiska konceptet idag Context Window. Detta avgör hur mycket information AI:n kan "ha i åtanke" under en konversation. Moderna modeller stödjer nu enorma fönster, vilket gör att du kan ladda upp hela tekniska dokumentationer eller kodbaser för AI:n att analysera utan att tappa bort de ursprungliga instruktionerna. Det är här Prompt Engineering blir en högst effektiv färdighet – att strukturera din input för att styra modellens fokus.

För att maximera kvaliteten på din output, använd vår ChatGPT Prompt Optimizer för att förfina dina instruktioner för resultat i företagsklass.

Företagets utbildningspipeline

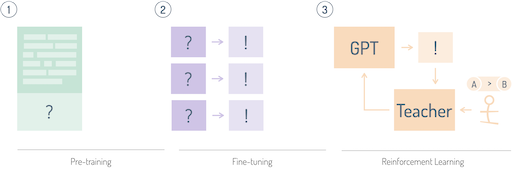

Att bygga en produktionsklar modell som GPT-4o eller Claude 3.5/4 innebär tre avancerade steg:

- Självövervakad förträning: Modellen "läser" den öppna webben och privata dataset för att lära sig språkets struktur, logik och till och med grundläggande programmering.

- Instruktionsfinjustering: Modellen tränas på noggrant utvalda par av frågor och svar. Detta lär AI:n hur den ska bete sig som en hjälpsam assistent snarare än bara en textkompletterare.

- Preferensjustering (RLHF & DPO): Genom tekniker som Reinforcement Learning from Human Feedback (RLHF) "putsas" modellen av mänskliga testare som rankar svaren. Detta säkerställer att AI:n förblir säker, hjälpsam och i linje med företagets värderingar.

Auto-regressiv generering och sampling

När AI genererar ett svar använder den auto-regressiv generering—den förutspår nästa token baserat på alla tidigare tokens i sekvensen. För att förhindra att AI blir för repetitiv eller "robotlik", använder vi samplingstekniker (som Top-P och Temperature).

Att justera Temperaturen gör det möjligt för affärsanvändare att växla mellan "Precision" och "Kreativitet." En låg temperatur (0,1) är idealisk för juridiska sammanfattningar eller datautvinning, medan en hög temperatur (0,8+) är bättre för att brainstorma marknadsföringsslagord eller kreativt skrivande.

Framtidssäkra ditt företag: Bortom chatboten

År 2026 ligger det verkliga värdet av Generativ AI i Retrieval-Augmented Generation (RAG) och AI-agenter. RAG gör det möjligt för AI att "slå upp" ditt företags privata, realtidsdata innan den svarar, vilket i praktiken eliminerar hallucinationer. Samtidigt kan AI-agenter nu utföra uppgifter—som att boka möten, uppdatera CRM-system eller skriva och distribuera kod—autonomt.

Att implementera dessa teknologier handlar inte bara om effektivitet; det handlar om att bygga en skalbar, datadriven vallgrav runt ditt företag. Att förstå dessa grundläggande principer säkerställer att du kan leda din organisation genom AI-övergången med självförtroende.

Framtidens arbete understöds inte bara av AI – det accelereras av det.