Maksimering af ROI med Generativ AI:

En strategisk guide for forretningsledere

Generativ AI er gået fra at være en nyhed til at være den centrale motor i moderne forretningsdrift. I 2026 handler det ikke længere kun om chatbots; det drejer sig om autonome agenter, automatiserede arbejdsgange og højhastigheds datasyntese. Men hvordan fungerer denne teknologi egentlig under overfladen, og hvordan kan din organisation udnytte den sikkert?

Hvad er Generativ AI i 2026?

Generativ AI er en underkategori af kunstig intelligens, der er designet til at skabe originalt indhold—fra tekst og kode til højopløselige billeder og syntetiske data. I modsætning til traditionel "Diskriminerende AI," som blot klassificerer eksisterende data, bruger Generativ AI avancerede neurale netværk til at genkende underliggende mønstre og syntetisere helt nye output, der efterligner menneskelig kreativitet og logik.

For virksomheder betyder dette enorme gevinster i skalerbarhed, hvilket gør det muligt for teams at automatisere komplekse kognitive opgaver, der tidligere krævede manuel indgriben.

Hvordan fungerer generativ AI? (LLM-arkitekturen)

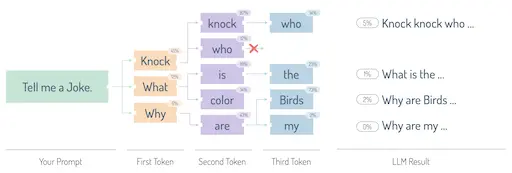

Moderne generativ AI drives primært af store sprogmodeller (LLMs). Oprindeligt introduceret af Googles artikel "Attention is All You Need", fungerer disse modeller som sofistikerede probabilistiske motorer. Når du giver en prompt, beregner modellen sandsynligheden for det næste "token" (ord eller fragment) baseret på billioner af datapunkter, den har behandlet under træningen. Den "kender" ikke fakta i menneskelig forstand; den forudsiger den mest statistisk logiske fortsættelse af din tanke.

Transformers og kontekstvinduer: AI'ens "hjerne"

Transformer-arkitekturen er det, der gør det muligt for AI at forstå kontekst. I modsætning til ældre modeller, der læser tekst lineært, bruger Transformers "Attention Mechanisms" til at se på et helt dokument samtidigt.

For CTO'er er det mest kritiske koncept i dag Context Window. Dette bestemmer, hvor meget information AI'en kan "holde i tankerne" under en samtale. Moderne modeller understøtter nu massive vinduer, hvilket giver dig mulighed for at uploade hele tekniske dokumentationer eller kodebaser, som AI'en kan analysere uden at miste overblikket over de oprindelige instruktioner. Her bliver Prompt Engineering en færdighed med stor effekt – at strukturere dit input for at styre modellens fokus.

For at maksimere din outputkvalitet, brug vores ChatGPT Prompt Optimizer til at forfine dine instruktioner for resultater i virksomhedsklasse.

Virksomhedens træningspipeline

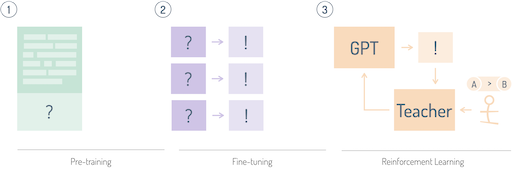

At bygge en produktionsklar model som GPT-4o eller Claude 3.5/4 involverer tre sofistikerede faser:

- Selvstyret forudtræning: Modellen "læser" det åbne internet og private datasæt for at lære sprogets struktur, logik og endda grundlæggende programmering.

- Instruktionsfinjustering: Modellen trænes på udvalgte par af spørgsmål og svar. Dette lærer AI'en, hvordan den skal opføre sig som en hjælpsom assistent frem for blot at fuldføre tekst.

- Præferencejustering (RLHF & DPO): Ved hjælp af teknikker som Forstærkningslæring fra menneskelig feedback (RLHF) bliver modellen "poleret" af menneskelige testere, der rangerer svarene. Dette sikrer, at AI'en forbliver sikker, hjælpsom og i overensstemmelse med virksomhedens værdier.

Auto-regressiv generering & sampling

Når AI'en genererer et svar, bruger den auto-regressiv generering — forudsigelse af det næste token baseret på alle tidligere tokens i sekvensen. For at forhindre, at AI'en bliver for gentagende eller "robotagtig," bruger vi samplingsteknikker (som Top-P og Temperatur).

Justering af Temperatur giver forretningsbrugere mulighed for at skifte mellem "Præcision" og "Kreativitet." En lav temperatur (0,1) er ideel til juridiske resuméer eller dataudtræk, mens en høj temperatur (0,8+) er bedre til brainstorming af markedsføringsslogans eller kreativ skrivning.

Fremtidssikring af din virksomhed: Udover chatbotten

I 2026 ligger den reelle værdi af Generativ AI i Retrieval-Augmented Generation (RAG) og AI-agenter. RAG gør det muligt for AI at "slå op" i din virksomheds private, realtidsdata, før den svarer, hvilket stort set eliminerer hallucinationer. Samtidig kan AI-agenter nu udføre opgaver—som at booke møder, opdatere CRM-systemer eller skrive og implementere kode—autonomt.

Implementeringen af disse teknologier handler ikke kun om effektivitet; det handler om at opbygge en skalerbar, datadrevet voldgrav omkring din virksomhed. At forstå disse grundlæggende principper sikrer, at du kan lede din organisation gennem AI-overgangen med selvtillid.

Fremtidens arbejde bliver ikke kun hjulpet af AI – det bliver accelereret af det.