Maksimere avkastning med generativ AI:

En strategisk guide for bedriftsledere

Generativ AI har utviklet seg fra å være en nyvinning til å bli kjernen i moderne forretningsdrift. Innen 2026 handler det ikke lenger bare om chatboter; det dreier seg om autonome agenter, automatiserte arbeidsflyter og høyhastighets datasyntese. Men hvordan fungerer egentlig denne teknologien under panseret, og hvordan kan organisasjonen din utnytte den på en sikker måte?

Hva er generativ AI i 2026?

Generativ KI er en underkategori av kunstig intelligens som er utviklet for å skape originalt innhold—alt fra tekst og kode til høyoppløselige bilder og syntetiske data. I motsetning til tradisjonell "Diskriminerende KI," som bare klassifiserer eksisterende data, bruker Generativ KI avanserte nevrale nettverk for å gjenkjenne underliggende mønstre og syntetisere helt nye resultater som etterligner menneskelig kreativitet og logikk.

For bedrifter betyr dette enorme gevinster i skalerbarhet, noe som gjør det mulig for team å automatisere komplekse kognitive oppgaver som tidligere krevde manuell inngripen.

Hvordan fungerer generativ KI? (LLM-arkitekturen)

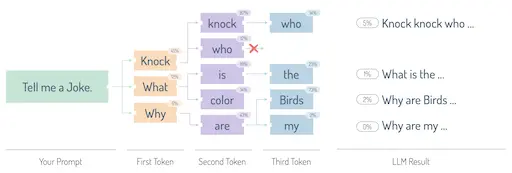

Moderne generativ AI drives hovedsakelig av store språkmodeller (LLMs). Opprinnelig introdusert av Googles "Attention is All You Need"-artikkel, fungerer disse modellene som sofistikerte sannsynlighetsmotorer. Når du gir en prompt, beregner modellen sannsynligheten for neste "token" (ord eller fragment) basert på billioner av datapunkter den har behandlet under treningen. Den "vet" ikke fakta på menneskelig vis; den forutsier den mest statistisk logiske fortsettelsen av tanken din.

Transformere og kontekstvinduer: AI-ens "hjerne"

Transformer-arkitekturen er det som gjør at AI kan forstå kontekst. I motsetning til eldre modeller som leser tekst lineært, bruker Transformere "Attention Mechanisms" for å se på hele dokumentet samtidig.

For CTO-er er det mest kritiske konseptet i dag Context Window. Dette bestemmer hvor mye informasjon AI-en kan "holde i minnet" under en samtale. Moderne modeller støtter nå massive vinduer, som lar deg laste opp hele tekniske dokumentasjoner eller kodebaser for at AI-en skal analysere uten å miste oversikten over de opprinnelige instruksjonene. Her blir Prompt Engineering en ferdighet med stor innvirkning—å strukturere innspillene dine for å styre modellens fokus.

For å maksimere kvaliteten på resultatene dine, bruk vår ChatGPT Prompt Optimizer for å forbedre instruksjonene dine for resultater på bedriftsnivå.

Opplæringsløpet for bedrifter

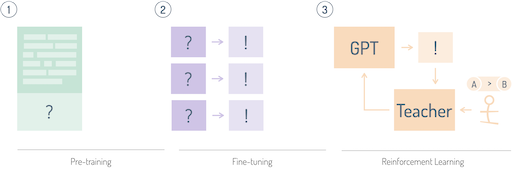

Å bygge en produksjonsklar modell som GPT-4o eller Claude 3.5/4 innebærer tre sofistikerte faser:

- Selv-overvåket forhåndstrening: Modellen "leser" det åpne nettet og private datasett for å lære språkets struktur, logikk og til og med grunnleggende programmering.

- Instruksjonsfinjustering: Modellen trenes på kuraterte par av spørsmål og svar. Dette lærer AI-en hvordan den skal oppføre seg som en hjelpsom assistent i stedet for bare en tekstfullfører.

- Preferansejustering (RLHF & DPO): Ved å bruke teknikker som forsterkende læring fra menneskelig tilbakemelding (RLHF), blir modellen "polert" av menneskelige testere som rangerer svarene. Dette sikrer at AI-en forblir trygg, hjelpsom og i tråd med selskapets verdier.

Auto-regressiv generering og sampling

Når AI genererer et svar, bruker den auto-regressiv generering—forutsier neste token basert på alle tidligere tokens i sekvensen. For å forhindre at AI blir for repetitiv eller "robotisk," bruker vi samplingsteknikker (som Top-P og temperatur).

Å justere Temperaturen lar forretningsbrukere veksle mellom "Presisjon" og "Kreativitet." En lav temperatur (0,1) er ideell for juridiske sammendrag eller datauttrekk, mens en høy temperatur (0,8+) er bedre for idémyldring av markedsføringsslagord eller kreativ skriving.

Fremtidssikring av virksomheten din: Bortenfor chatboten

I 2026 ligger den reelle verdien av Generativ AI i Retrieval-Augmented Generation (RAG) og AI-agenter. RAG gjør det mulig for AI å "slå opp" selskapets private, sanntidsdata før den svarer, noe som i praksis eliminerer hallusinasjoner. Samtidig kan AI-agenter nå utføre oppgaver—som å booke møter, oppdatere CRM-systemer eller skrive og distribuere kode—autonomt.

Å implementere disse teknologiene handler ikke bare om effektivitet; det handler om å bygge en skalerbar, datadrevet vollgrav rundt virksomheten din. Å forstå disse grunnprinsippene sikrer at du kan lede organisasjonen din gjennom AI-overgangen med selvtillit.

Fremtiden for arbeid er ikke bare hjulpet av AI—den blir akselerert av det.